Entre el 19 y el 23 de enero de 2026, el Foro Económico Mundial reunió en Davos, Suiza, a más de 3,000 participantes de 130 países, incluyendo 850 CEO y 60 jefes de Estado. De este grupo, 47 líderes confirmados del sector de IA compartieron sus evaluaciones sobre el futuro de la inteligencia artificial durante cinco días de sesiones, paneles y declaraciones públicas.

Las discusiones abarcaron desde debates sobre timelines para alcanzar inteligencia artificial general —con proyecciones que varían entre 1 y 10 años— hasta análisis detallados sobre la implementación de agentes autónomos que ya operan a escala empresarial. Pasando por evaluaciones institucionales sobre el impacto laboral, que proyectan impactar entre el 40-60 % de los empleos globales.

También se abordaron restricciones de infraestructura energética, con estimaciones que indican que los centros de datos o data centers podrían consumir para 2030 el equivalente eléctrico de Alemania y Francia combinadas.

Además, hubo un gran debate en torno a la fragmentación del panorama regulatorio global, con 90 países desarrollando estrategias nacionales de IA y 33 con una legislación específica ya en vigor.

Mientras se celebraba esta edición del Foro en Suiza, millones de personas en todo el mundo experimentaban con herramientas como ChatGPT para realizar tareas cotidianas.

Pero, en contraste, en las salas de conferencias de Davos se discutían escenarios significativamente diferentes sobre el futuro de la inteligencia artificial.

Este artículo documenta verdades, declaraciones y proyecciones sobre el futuro de la IA que emergieron de Davos 2026, compartidas por los 47 líderes más influyentes en inteligencia artificial que se dieron cita en dicho evento.

¿Cuál es el futuro de la inteligencia artificial?

Jamie Dimon, CEO de JPMorgan Chase, presentó una declaración notable: afirmó públicamente que los gobiernos deberían tener capacidad de intervenir en despidos masivos causados por inteligencia artificial.

“No puedes despedir a dos millones de camioneros mañana… Tendrás disturbios civiles”, dijo.

El CEO también admitió que contratará “menos personas en los próximos cinco años debido a la IA”, reconociendo que si esta tendencia se generaliza rápidamente, las consecuencias sociales podrían justificar una intervención gubernamental.

Esa declaración de Dimon marcó el tono de lo que sería una semana de evaluaciones francas y, en muchos casos, sorprendentemente cautelosas sobre el futuro de la inteligencia artificial.

A diferencia de eventos anteriores donde predominaba el optimismo sobre las capacidades transformadoras de la IA, Davos 2026 se caracterizó por un enfoque en riesgos concretos, timelines divergentes y la urgencia de desarrollar marcos de gobernanza efectivos.

Proyecciones divergentes sobre el futuro de la inteligencia artificial general

El debate central en Davos 2026 sobre el futuro de la inteligencia artificial giró en torno a una pregunta fundamental:

¿Cuánto tiempo falta para que los sistemas de IA alcancen capacidades equiparables a las humanas en prácticamente todas las tareas cognitivas?

Los líderes tecnológicos presentaron evaluaciones que difieren sustancialmente en años, incluso décadas.

-

Elon Musk: “La IA podría superar a la inteligencia colectiva de toda la humanidad”.

Elon Musk, actual CEO de Tesla, presentó el pronóstico más acelerado sobre el futuro de la inteligencia artificial durante su primera aparición en el Foro Económico Mundial.

“Podríamos tener IA más inteligente que cualquier humano para finales de este año”, declaró.

Asimismo, Musk proyectó que en cinco años la IA podría superar a la inteligencia colectiva de toda la humanidad, y predijo que “habrá más robots que personas”, según reseñó EuroNews.

De igual forma, dijo que Tesla planea vender robots humanoides Optimus al público en 2027.

Paralelamente, sobre el impacto económico del futuro de la inteligencia artificial, Musk describió un escenario de abundancia:

“Si tienes IA ubicua que es esencialmente gratis y robótica ubicua, tendrás una explosión en la economía global verdaderamente sin precedentes”.

-

Dario Amodei: Los modelos de IA podrían eliminar el 50 % de los empleos de oficina en cinco años

Por su parte, Dario Amodei, CEO de Anthropic (empresa creadora de Claude), especificó timelines concretos para diferentes capacidades en el futuro de la inteligencia artificial.

Según Amodei, los modelos de IA podrían reemplazar el trabajo de todos los desarrolladores de software en un año, alcanzar investigación científica, nivel Premio Nobel —en dos años— y eliminar el 50 % de los empleos de oficina en cinco años.

Amodei también advirtió sobre escenarios de concentración económica en el futuro de la inteligencia artificial, estimando que ciertas regiones tecnológicas podrían experimentar un crecimiento del PIB del 50 %.

Mientras que, a su juicio, otras economías se estancarían, creando lo que llamó un “país de grado cero” emergente, uno donde la economía se desacoplaría del resto del mundo.

En sus palabras: “La pesadilla sería que emerja este ‘país de grado cero’… ese sería un mundo distópico”.

Proyecciones del CEO de Google DeepMind sobre el futuro de la inteligencia artificial

Del otro lado del debate sobre el futuro de la inteligencia artificial, Demis Hassabis, CEO de Google DeepMind y ganador del Premio Nobel de Química 2024, ofreció una evaluación significativamente más conservadora.

“Los sistemas de IA de hoy están ‘nowhere near’ (muy lejos de) la inteligencia artificial general a nivel humano”, afirmó.

Brechas técnicas que afectarían el futuro de la inteligencia artificial

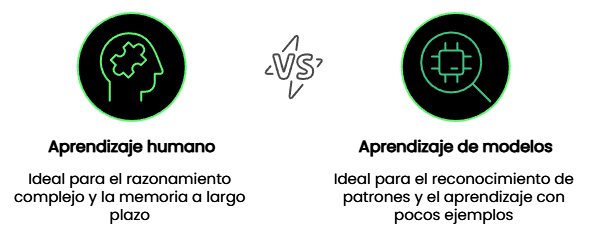

A su vez, identificó brechas técnicas fundamentales que afectan el futuro de la inteligencia artificial, como por ejemplo:

- Aprendizaje con pocos ejemplos: Los humanos aprenden de 1-2 casos, mientras que los modelos requieren millones de ejemplos.

- Aprendizaje continuo: Los humanos pueden aprender constantemente sin olvidar el conocimiento anterior, mientras que los modelos actuales presentan limitaciones.

- Memoria a largo plazo: Los modelos tienen ventanas de contexto limitadas comparadas con décadas de memoria humana.

- Razonamiento y planificación avanzados: Los modelos actuales son efectivos para reconocer patrones, pero limitados en el razonamiento causal complejo.

Hassabis estimó un 50 % de probabilidad de alcanzar inteligencia artificial general (AGI) “dentro de la década”, pero enfatizó que “tal vez necesitemos uno o dos avances fundamentales más antes de llegar a AGI”.

En consecuencia, esta evaluación sobre el futuro de la inteligencia artificial difiere sustancialmente del timeline de 1-2 años propuesto por Musk y Amodei.

La industria de la IA y los LLM

En este contexto, Yann LeCun, fundador de AMI Labs y ganador del Premio Turing, presentó una crítica fundamental al paradigma actual que domina el futuro de la inteligencia artificial.

Dijo que “la industria de IA está completamente obsesionada con LLM”. Su argumento central es que “nunca vamos a llegar a inteligencia a nivel humano entrenando solo con texto. Necesitamos el mundo real”.

Como evidencia de las limitaciones del enfoque actual para el futuro de la inteligencia artificial, LeCun señaló lo siguiente: “Por eso no tenemos robots domésticos o autos autónomos de nivel 5 todavía”.

Los sistemas actuales pueden aprobar exámenes de abogacía y escribir código, pero presentan dificultades en tareas que requieren interacción con el mundo físico.

Y esa fue una de las principales motivaciones de LeCun para dejar Meta en noviembre de 2025 y fundar AMI Labs (Advanced Machine Intelligence Labs), enfocándose en desarrollar sistemas multimodales que aprenden del mundo físico.

La crítica de LeCun al paradigma dominante establece el contexto para comprender por qué la industria está pivotando hacia una nueva frontera: la convergencia de inteligencia artificial con sistemas que operan en el mundo físico.

Si los modelos entrenados solo con texto tienen limitaciones fundamentales para tareas que requieren percepción y manipulación física, entonces el siguiente paso evolutivo del sector implica desarrollar sistemas que puedan tanto razonar como actuar en entornos reales.

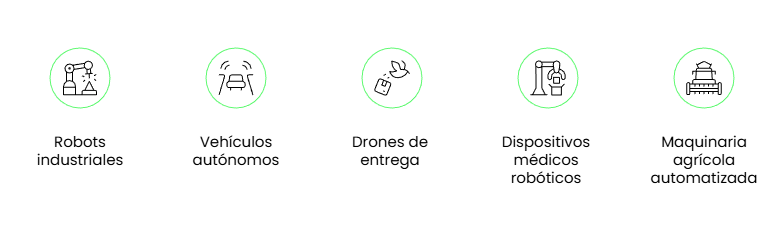

Esta transición de IA puramente digital hacia Physical AI representa uno de los cambios estratégicos más significativos discutidos en Davos 2026.

Physical AI representa la integración de capacidades de inteligencia artificial con sistemas que operan en el mundo físico, como:

Physical AI y sus implicaciones en el sector económico

A diferencia de los modelos de lenguaje que procesan información digital, Physical AI debe percibir entornos tridimensionales mediante sensores, tomar decisiones en tiempo real considerando variables físicas como peso y fricción, y ejecutar acciones mecánicas precisas.

Esta convergencia tiene implicaciones directas para múltiples sectores económicos:

- Empresas manufactureras enfrentarán competidores que pueden operar una producción 24/7 con costos laborales reducidos.

- Compañías logísticas verán transformaciones en almacenamiento y transporte.

- Probablemente, los negocios de servicios tendrán que redefinir sus propuestas de valor cuando las tareas físicas rutinarias se automaticen.

Para emprendedores y dueños de negocio, comprender qué capacidades de Physical AI son comercialmente viables hoy, versus cuáles permanecen en desarrollo, es crítico para su planificación estratégica.

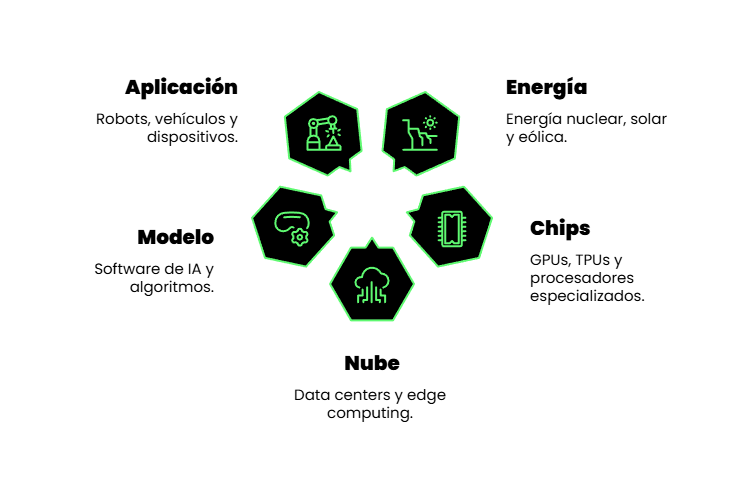

El modelo del “five-layer cake” del CEO de Nvidia

En Davos, Jensen Huang, CEO de Nvidia, presentó su modelo del “five-layer cake” que debe escalar simultáneamente para que la Physical AI funcione:

Este framework es relevante para empresas evaluando inversiones en automatización:

Un proyecto de Physical AI exitoso no solo requiere comprar robots, sino asegurar energía confiable, capacidad computacional adecuada y un software que integre estos componentes.

Para ello, declaró que hay “cientos de miles de millones de dólares ya invertidos, con billones más por venir”.

Sobre la industria de la robótica, Huang declaró que es “una oportunidad generacional para las naciones europeas”, argumentando que la fusión de décadas de experiencia manufacturera europea con la inteligencia artificial puede posicionar a Europa en liderazgo en Physical AI.

Para las empresas manufactureras, esto sugiere que ciertas ventajas competitivas, asociadas tradicionalmente a procesos industriales, pueden amplificarse mediante la adopción temprana de sistemas robóticos inteligentes.

Por eso las invitó a que “entren ahora, temprano, para que puedan fusionar su capacidad industrial —su capacidad de manufactura— con inteligencia artificial y eso los lleve al mundo de Physical AI o a la robótica”.

Physical AI y su impacto laboral

En cuanto al impacto laboral, Huang presentó proyecciones sobre trabajos manuales especializados que contradicen las narrativas de automatización total.

“Lo maravilloso es que los trabajos están relacionados con oficios manuales: vamos a tener plomeros y electricistas… Estamos viendo un boom significativo y los salarios han subido. Casi el doble”, declaró el CEO de Nvidia.

En su opinión, construir y mantener la infraestructura masiva de Physical AI requiere oficios especializados como electricistas, técnicos, plomeros y mecánicos.

Para los negocios de servicios técnicos y capacitación, esto representa una oportunidad de crecimiento en sectores que muchos consideraban en declive.

Dina Powell McCormick, presidenta de Meta, confirmó esta tendencia con datos específicos: “Esta nueva fase de computación requerirá 500,000 electricistas en el país”.

Asimismo, Cristiano Amon, CEO de Qualcomm, definió a la Physical AI como el “core focus” de la estrategia de su empresa.

Amon presentó el futuro como “colaboración ‘cloud + edge’, no uno u otro”, argumentando que “quien tenga presencia en el edge va a ganar”, porque “el edge es donde están los humanos”.

¿Qué es Edge Computing?

Edge computing se refiere a procesar datos localmente, en dispositivos, en lugar de enviarlos a servidores remotos.

Esta arquitectura ofrece:

- Latencia cero. Respuesta instantánea sin retrasos.

- Privacidad. Los datos permanecen en el dispositivo, protegiendo la información.

- Costo reducido. Elimina los pagos por consultas a servidores remotos.

- Confiabilidad. Funcionamiento sin conexión a Internet, asegurando la disponibilidad.

Para empresas considerando soluciones de Physical AI, la decisión entre una arquitectura cloud versus edge tiene implicaciones significativas en costos operacionales, dependencia de conectividad y control sobre datos propietarios.

Según Amon, “quien esté presente en el edge tendrá un mejor modelo con el tiempo”, debido al acceso a datos contextuales únicos disponibles localmente.

¿El futuro de la inteligencia artificial es puramente robótico?

Daniela Rus, directora del MIT CSAIL (Computer Science & Artificial Intelligence Lab), proporcionó una evaluación del estado actual de la robótica que clarifica qué capacidades son comercialmente viables hoy.

“Tenemos flotas completas de robots operando 24/7, moviendo contenedores sin intervención humana”, reportó.

Estos sistemas comerciales operan actualmente en puertos, almacenes y centros logísticos de empresas como Amazon, Alibaba y DHL.

Para los negocios que operan en la industria logística o manufacturera, esto indica que la automatización de tareas repetitivas en entornos estructurados equivale a una tecnología madura disponible para implementación.

Sin embargo, Rus identificó limitaciones persistentes:

“Todavía tenemos desafíos con la manipulación. Necesitamos mejores sensores; nuestros robots carecen de la sensación similar a la piel humana”.

La brecha entre sensores robóticos y piel humana es significativa. Los dedos humanos tienen miles de receptores táctiles que detectan simultáneamente presión, textura, temperatura y dolor, mientras que los sensores robóticos actuales son considerablemente más limitados.

Esta limitación explica por qué los robots pueden mover cajas en almacenes estructurados, pero presentan dificultades para doblar ropa o preparar alimentos.

Para restaurantes, hoteles, servicios de limpieza y otros negocios que requieren manipulación delicada de objetos variados, esto significa que la automatización completa no es viable en el corto plazo.

Rus también mencionó que “la teleoperación sigue siendo esencial para muchos robots”, indicando que varios sistemas presentados como autónomos tienen humanos interviniendo cuando las situaciones son ambiguas.

Proyecciones sobre el impacto laboral en el futuro de la inteligencia artificial

El desplazamiento laboral causado por la inteligencia artificial representará uno de los factores más críticos para empresas, emprendedores y profesionales en los próximos 3-5 años.

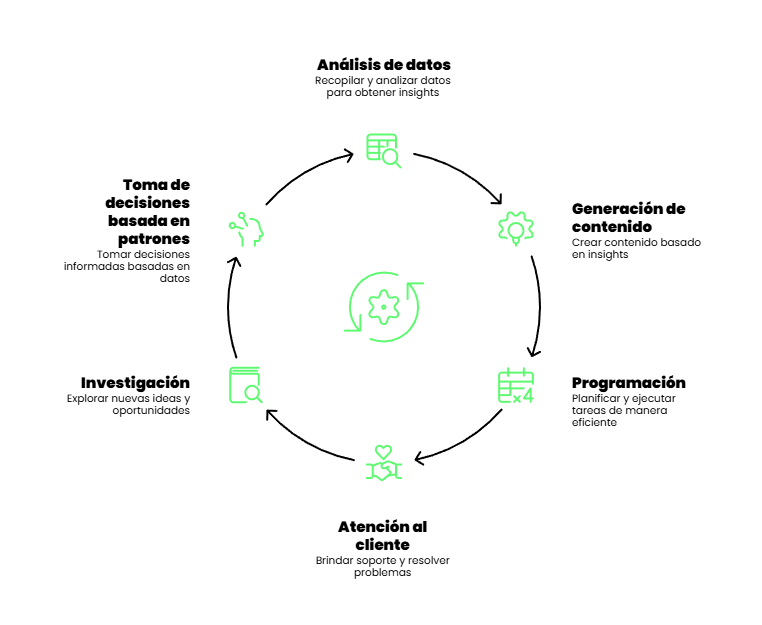

A diferencia de automatizaciones previas que afectaron principalmente al trabajo manual repetitivo, la inteligencia artificial actual puede ejecutar tareas cognitivas:

Esto significa que sectores previamente considerados “a prueba de automatización” —servicios profesionales, trabajadores del conocimiento, roles administrativos— enfrentan transformación.

Para dueños de negocio, esto plantea decisiones estratégicas inmediatas:

- ¿Qué roles en mi organización serán afectados primero?

- ¿Debo invertir en reentrenamiento o reestructurar equipos?

- ¿Mis competidores están adoptando estas tecnologías más rápido?

En contraste, para profesionales y emprendedores, las preguntas son igualmente urgentes:

- ¿Mi especialización seguirá siendo demandada?

- ¿Qué habilidades debo desarrollar?

- ¿Qué nuevas oportunidades emergen?

La IA es “un tsunami golpeando el mercado laboral”

Las evaluaciones presentadas en Davos 2026 por líderes de instituciones globales y CEO de empresas implementando IA a escala ofrecen un marco para responder estas preguntas.

Kristalina Georgieva, Directora Gerente del Fondo Monetario Internacional (FMI), presentó la evaluación institucional más contundente:

El FMI estima que el 40 % de los empleos globales serán afectados por la inteligencia artificial, cifra que aumenta al 60 % en las economías avanzadas.

Estas proyecciones del FMI se convierten en un insumo oficial para la planificación gubernamental y corporativa.

No obstante, es importante entender qué significa “afectados”: no necesariamente eliminados, pero sí transformados.

Por ejemplo, un rol puede requerir un 30 % menos de personal, o el mismo personal con habilidades completamente diferentes, o desaparecer mientras emergen roles nuevos.

Para las empresas, esto significa que la planificación de recursos humanos a 3-5 años requiere considerar estos escenarios explícitamente.

Empleos en riesgo por la inteligencia artificial

Alex Karp, CEO de Palantir Technologies, emitió una declaración contundente sobre los segmentos laborales en riesgo por la IA:

“Destruirá empleos de humanidades”, aseveró, refiriéndose especialmente a los trabajadores del conocimiento con educación universitaria en áreas como:

- Filosofía.

- Literatura.

- Ciencias sociales.

Esta declaración es particularmente relevante para esos profesionales, cuyos roles dependen primariamente de análisis, síntesis de información y comunicación escrita —capacidades donde los modelos de lenguaje actuales demuestran competencia—.

Igualmente, Larry Fink, CEO de BlackRock y co-chairman interino del Foro Económico Mundial, articuló implicaciones sobre la IA con perspectiva histórica:

“Si la IA hace a los trabajadores de oficina lo que la globalización hizo a los trabajadores manuales, necesitamos confrontar esa realidad directamente. No con abstracciones sobre trabajos del mañana, sino con un plan creíble para una participación amplia”.

La analogía con la globalización es instructiva: durante 1990 y 2010, el sector manufacturero en los países desarrollados perdió millones de empleos mientras emergían nuevos sectores, pero la transición causó décadas de dislocación económica en comunidades dependientes de la industria manufacturera.

En tal sentido, Fink sugiere que, sin una planificación deliberada, millones de trabajadores de oficina podrían enfrentar una trayectoria similar.

Muchos roles cambiarán a causa de la IA

Efectivamente. Andy Jassy, CEO de Amazon, identificó áreas específicas de impacto inmediato:

“Los trabajos van a ser impactados… IA y agentes permitirán coding, servicio al cliente, investigación y analítica”.

Para las empresas en estos sectores, esto no es una proyección futura, sino una realidad inminente.

Amazon ya implementa IA en su servicio al cliente; desarrolladores ya usan herramientas de coding asistido; equipos de investigación ya automatizan análisis de datos.

La pregunta no es si estos roles cambiarán, sino qué tan rápido y cuánto personal será necesario en versiones transformadas de estos roles.

Jassy también enfatizó que, dado que cada consulta a un modelo de IA genera un costo computacional (inferencia), “el costo de inferencia tiene que bajar” para que la adopción masiva sea viable.

No en vano, Amazon está desarrollando su propio chip de IA, Trainium2, que según Jassy es “aproximadamente un 40 % más eficiente en precio-rendimiento que las GPUs líderes”, mientras que “Anthropic está construyendo Claude en cientos de miles de nuestros chips Trainium2”, añadió.

Para las empresas evaluando la adopción de IA, esto significa que los costos operacionales de herramientas de IA continuarán disminuyendo, haciendo económicamente viable automatizar roles que hoy, todavía, justifican un empleo humano.

Este es un análisis financiero simple: si automatizar un rol cuesta $50,000/año en infraestructura de IA, pero ese rol genera $80,000/año en salario y beneficios, la adopción es inevitable conforme los costos de inferencia disminuyen.

Energía: Crítica para el desarrollo de nuevas tecnologías con IA

Las proyecciones sobre desplazamiento laboral presentadas por el FMI, BlackRock, Amazon y Palantir convergen en una conclusión:

La transformación del mercado laboral no es hipotética ni está a décadas de distancia. Al contrario, está en curso con una aceleración voraz, proyectada para 2026-2028.

Sin embargo, la velocidad y magnitud de esta transformación no dependen exclusivamente de capacidades algorítmicas o adopción empresarial.

Existe un factor limitante fundamental que determinará qué tan rápido pueden desplegarse sistemas de IA a escala global y, por lo tanto, qué tan rápido ocurrirá el desplazamiento laboral: la disponibilidad de energía.

Sin infraestructura energética suficiente, incluso los modelos más avanzados no pueden operar, los data centers no pueden expandirse y la automatización masiva no puede materializarse.

Infraestructura energética como factor determinante

La infraestructura energética ha emergido como el cuello de botella crítico que determinará el ritmo de adopción de inteligencia artificial en los próximos años.

Entrenar y operar modelos de IA requiere cantidades masivas de electricidad: un solo entrenamiento de modelo avanzado puede consumir la electricidad equivalente a cientos de hogares durante un año completo.

Ejecutar consultas (inferencia) para miles de millones de usuarios consume aún más energía en agregado. Esta demanda energética tiene implicaciones directas para empresas y gobiernos.

Para las empresas considerando infraestructura de IA propia, los costos energéticos representan 30-40 % del costo operacional total de los data centers.

Mientras que, para los gobiernos, el crecimiento proyectado en demanda eléctrica por IA podría estresar las redes eléctricas existentes.

A su vez, para los inversionistas, las compañías que aseguren acceso a energía confiable y asequible tendrán una ventaja competitiva sostenible.

Proyecciones energéticas y adopción de IA

Sin duda, entender las proyecciones energéticas y estrategias propuestas por líderes tecnológicos es crítico para evaluar la viabilidad de planes de adopción de IA.

En este sentido, Satya Nadella, CEO de Microsoft, introdujo la métrica macroeconómica que considera más relevante: “Tokens per Dollar per Watt”.

Nadella explicó lo siguiente: “Tenemos una nueva commodity: son tokens. El trabajo de cada economía y cada empresa en la economía es traducir estos tokens en crecimiento económico”.

Esta métrica es fundamental para empresas evaluando inversión en IA: no solo importa cuántos tokens (unidades de procesamiento de IA) produces, sino cuánto valor económico extraes por cada dólar invertido y por cada watt de energía consumida.

Las empresas que optimicen esta relación —maximizando los outputs de la IA, mientras minimizan los costos energéticos— tendrán una ventaja competitiva significativa.

Sin embargo, Nadella presentó una advertencia sobre legitimidad social:

“Perderemos rápidamente el permiso social para usar energía, que es un recurso escaso, y el de usarla para generar tokens, si estos tokens no están mejorando resultados de salud, educación, eficiencia del sector público y competitividad del sector privado en todos los sectores, pequeños y grandes”.

Este concepto de “permiso social” es crítico para empresarios y ejecutivos. Si el público percibe que los data centers consumen electricidad que podría alimentar hogares y hospitales, pero solo generan chatbots triviales o publicidad optimizada, podría haber resistencia política y regulatoria.

Para empresas implementando IA, esto significa que deben articular claramente el valor social y económico tangible de sus aplicaciones, no solo su eficiencia interna.

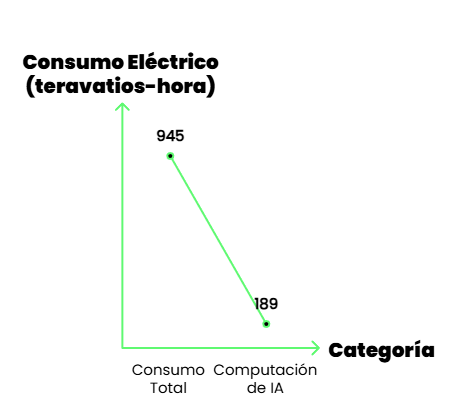

Para 2030, el consumo energético podría alcanzar 945 teravatios-hora anuales

Las proyecciones energéticas son sustanciales.

Goldman Sachs estima que los centros de datos globales pasarán de 55 gigawatts actualmente a 84 gigawatts en dos años.

Y para 2030, el consumo podría alcanzar 945 teravatios-hora anuales, el equivalente al consumo eléctrico combinado de Alemania y Francia.

Por si fuese poco, aproximadamente un 20 % del crecimiento de la demanda eléctrica global provendrá de computación relacionada con IA.

84 gigavatios equivalen a la capacidad de aproximadamente 56-84 plantas nucleares —dependiendo del tamaño de cada planta, que típicamente generan entre 1-1.5 gigavatios—.

Construir esta capacidad en dos años representa un desafío de infraestructura sin precedentes, considerando que una sola planta nuclear tarda 7-10 años en construirse.

Entonces, para las empresas planificando data centers o adoptando computación en la nube, esto significa que la disponibilidad y los costos de la electricidad podrían ser variables limitantes para 2027-2029.

Ante semejante escenario, la energía nuclear emergió como una solución propuesta por múltiples líderes presentes en Davos.

Órdenes ejecutivas firmadas en mayo 2025 incluyen la generación de 300 gigawatts de nueva capacidad nuclear para 2030, el aumento de la producción doméstica de combustible nuclear y la aceleración del proceso regulatorio para la aprobación de nuevos reactores.

Bank of America señaló que “en muchos sentidos la energía nuclear ha sido recientemente ‘redescubierta’, encendida por el surgimiento de IA/data centers, electrificación de edificios, crecimiento industrial y adopción de vehículos eléctricos”.

La industria de la IA está impulsando el renacimiento nuclear

Para los inversionistas, esto abre oportunidades en la cadena de suministro nuclear: uranio, construcción de reactores, tecnologías de enfriamiento y empresas especializadas en pequeños reactores modulares (SMRs).

Andy Jassy y Satya Nadella confirmaron que los hyperscalers (Amazon, Microsoft, Google, Meta) están comprometiéndose a autofinanciar la infraestructura energética.

“No esperamos que otros paguen por nosotros. Esperamos financiar la energía que necesitamos”, declaró Jassy.

Esta infraestructura incluye acuerdos directos con productores de energía nuclear y construcción de pequeños reactores modulares adyacentes a los data centers.

Esta estrategia tiene implicaciones competitivas: Las empresas tecnológicas que aseguren un acceso garantizado a la energía nuclear podrán operar data centers sin depender de redes eléctricas públicas volátiles o caras.

No obstante, para las empresas más pequeñas, sin capital para financiar energía propia, esto podría crear una desventaja estructural.

¿Por qué? Dependerán de proveedores cloud cuyos costos reflejarán sus propias inversiones en infraestructura energética.

2026: El “Año del agua”

Davos 2026 fue designado como el “Año del agua”, bajo la iniciativa “Blue Davos”.

Como es bien sabido, los centros de datos consumen agua masivamente para el enfriamiento de servidores.

Por tanto, las proyecciones indican que casi un tercio del PIB global ($31 trillones de dólares) enfrentaría un alto estrés hídrico para 2050.

Pero, considerando que 2.1 mil millones de personas carecen de acceso a agua potable segura, esas proyecciones están creando tensiones en torno a los recursos necesarios para la infraestructura de IA.

Para las empresas construyendo o expandiendo data centers, el acceso al agua es tan crítico como el acceso a la electricidad.

En consecuencia, regiones con abundancia de agua y energía (Escandinavia, Canadá, partes de EEUU) podrían convertirse en los hubs preferidos para la infraestructura de IA.

Sin embargo, los gobiernos en regiones sometidas a estrés hídrico podrían limitar la construcción de nuevos data centers, afectando dónde las empresas pueden operar infraestructura propia versus depender de proveedores cloud.

La IA y las restricciones energéticas y de agua

Es innegable: Las restricciones energéticas y de agua no son obstáculos temporales que se resolverán con más inversión, sino limitaciones físicas fundamentales que definirán qué empresas, regiones y países pueden participar en la economía de IA en los próximos años.

Microsoft, Amazon y otros hyperscalers están asegurando acceso garantizado a la energía nuclear porque reconocen que, sin infraestructura energética propia, sus ambiciones de IA son inviables.

Esta realidad crea una nueva pregunta estratégica: si la infraestructura física determina quién puede desplegar IA a escala, ¿qué frameworks legales y regulatorios determinarán quién tiene permiso para hacerlo?

De cualquier forma, mientras algunas empresas compiten por acceso a la energía, ya hay gobiernos construyendo los sistemas de gobernanza que definirán las reglas del juego en el futuro.

Gobernanza y regulación del futuro de la inteligencia artificial

La regulación de la inteligencia artificial se ha convertido en un factor crítico que afectará directamente la viabilidad operacional de las empresas que implementarán IA en los próximos 2 o 3 años.

A diferencia de debates abstractos sobre ética, la regulación emergente tiene consecuencias concretas:

Qué sistemas pueden desplegarse, qué requisitos de documentación y auditoría deben cumplirse, qué penalidades enfrentan empresas por incumplimiento y qué responsabilidades legales asumen por decisiones tomadas por los sistemas de IA.

Para empresas multinacionales, la fragmentación regulatoria global crea una complejidad operacional sustancial:

Un sistema de IA que cumple regulaciones en Estados Unidos puede violar leyes en Europa, requiriendo versiones diferentes por región.

Para startups y emprendedores, entender qué jurisdicciones tienen una regulación más favorable puede influir en decisiones sobre dónde incorporar y operar esta tecnología.

A su vez, para los inversionistas, las empresas que no anticipan un cumplimiento regulatorio enfrentan riesgo de penalidades, litigios y restricciones operacionales que afectan sus valuaciones.

El panorama regulatorio incluye 90 países con estrategias nacionales y 33 países con legislación vinculante específica.

La fragmentación crea desafíos operacionales significativos

En Estados Unidos no existe una ley federal comprehensiva; múltiples estados tienen regulaciones diferentes:

- Texas TRAIGA (efectivo enero 2026).

- Utah con requisitos de disclosure.

- Colorado con ley enfocada en riesgo (mediados 2026).

- California SB 53.

Para las empresas operando en múltiples estados, esto significa que un solo producto de IA puede requerir un cumplimiento con 4-5 regímenes regulatorios diferentes solo en Estados Unidos.

Por lo tanto, los costos de cumplimiento —equipos legales, auditorías, documentación técnica— pueden representar entre un 15 y un 25 % del presupuesto operacional para las empresas de IA en etapa temprana.

La IA y los sistemas de clasificación de riesgo

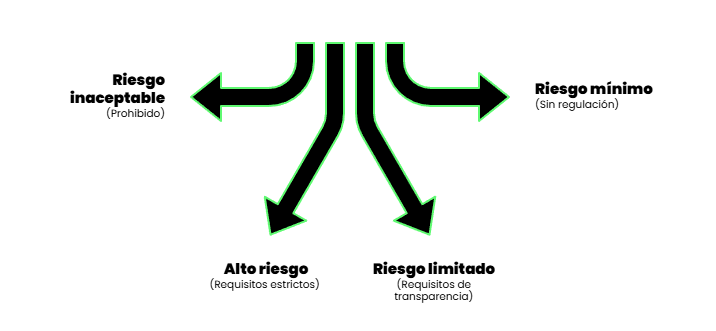

El EU AI Act, que entró en vigor en 2026, establece un sistema de clasificación de riesgo claro:

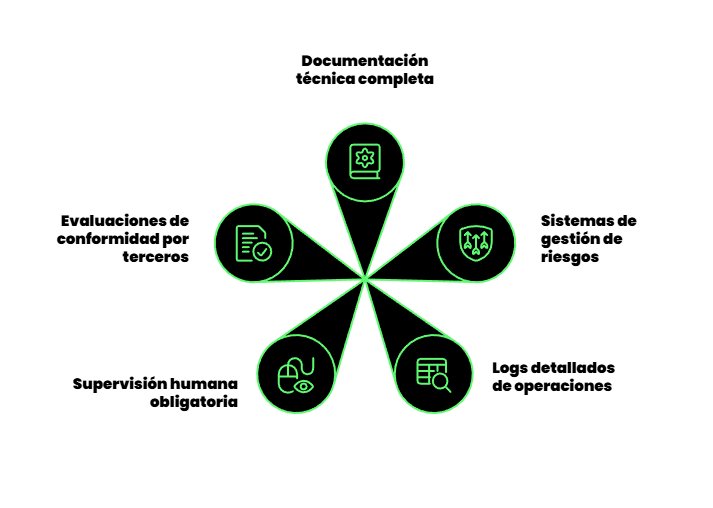

Esta clasificación es crítica para las empresas: sistemas clasificados como “alto riesgo” —incluyendo IA para decisiones de empleo, crédito, aplicación de ley y servicios esenciales— enfrentan requisitos extensos:

Por su parte, para las empresas de recursos humanos usando IA para screening de candidatos, o instituciones financieras usando IA para decisiones crediticias, estos requisitos son obligatorios y no negociables.

El incumplimiento puede resultar en multas de hasta €35 millones o del 7 % del revenue global anual —lo que sea mayor—.

Ante tal convergencia, Navrina Singh, CEO de Credo AI, expresó lo siguiente:

“La gente quiere políticas de IA que entiendan la complejidad operacional”.

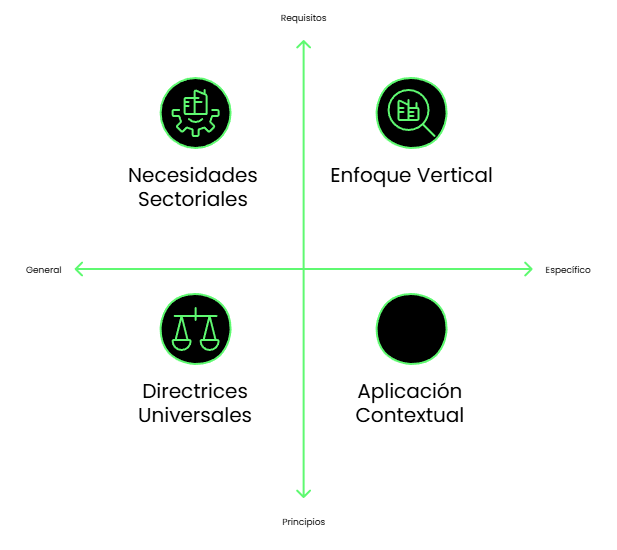

La era del “Context-Aware AI Policy”

Adicionalmente, identificó el “enfoque de mantequilla de maní”:

“Aplicar requisitos idénticos a todos los despliegues de IA genera sobrecarga de cumplimiento sin abordar riesgos reales”.

¿Qué significa esto? Un sistema de IA para el sector salud enfrenta riesgos completamente diferentes que un motor de recomendaciones de marketing.

La propuesta emergente es “Context-Aware AI Policy”, la cual balancea principios horizontales aplicables a todos (transparencia, accountability, fairness) con requisitos verticales específicos por sector (servicios financieros, salud, infraestructura crítica, retail/marketing).

A nivel empresarial, esto significa que, además de cumplir principios generales, deberán navegar regulaciones específicas de su industria.

Por ejemplo, una empresa de salud que implemente IA para diagnóstico debe cumplir tanto con la regulación general de IA (EU AI Act) como con una regulación específica de dispositivos médicos (FDA en EEUU, MDR en Europa).

Además, una empresa fintech debe cumplir con una regulación de IA más una regulación financiera existente (KYC, AML, fair lending).

Por ende, esta superposición de frameworks regulatorios multiplica la complejidad y los costos.

Sobre este punto, Yuval Harari argumentó que el futuro de la inteligencia artificial no es un destino predeterminado, sino el resultado de decisiones humanas sobre qué construir, cómo regularlo y qué valores incorporar.

Para emprendedores y ejecutivos, esto significa que la participación activa en el proceso regulatorio —comentarios públicos sobre legislación propuesta, colaboración con reguladores, membresías en organizaciones de industria— puede influir en las regulaciones emergentes.

“Runtime Governance”: Los sistemas ya no son herramientas de función fija

Por su parte, Navrina Singh, CEO y cofundadora de Credo AI, introdujo el concepto de “Runtime Governance”, señalando que los sistemas ya no son herramientas de función fija.

En su lugar, se adaptan mediante refuerzo, responden a interacciones, integran nueva información y coordinan con otros sistemas.

Paralelamente, se abordó algo clave:

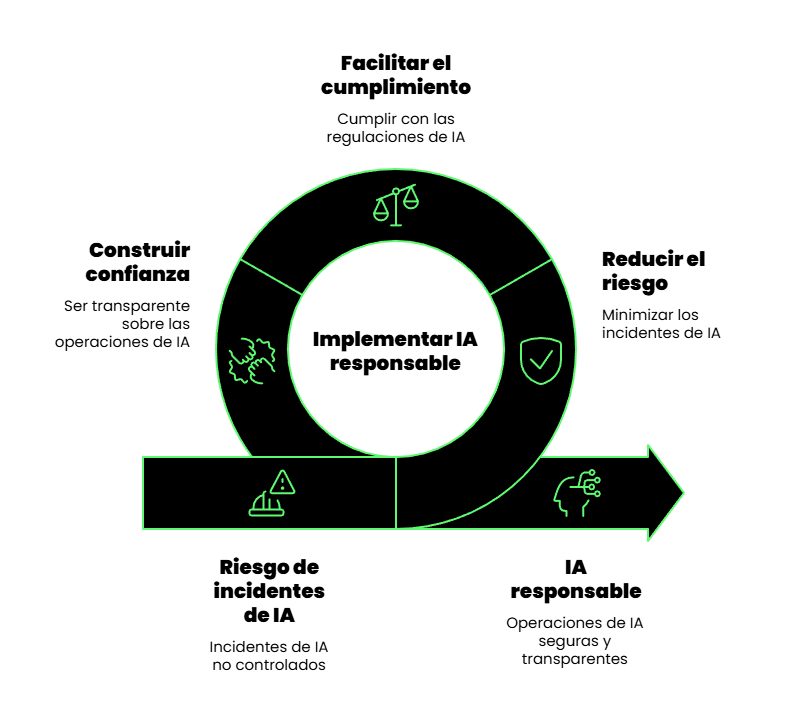

La nueva necesidad está anclada a una gobernanza que funcione mientras los agentes de IA están operando, con monitoreo continuo, alertas en tiempo real, capacidad de intervención inmediata y logs completos para auditoría.

Para empresas implementando IA, adoptar frameworks como estos proactivamente —antes de que sean mandatorios— puede proporcionar una gran ventaja competitiva:

- Reduciendo el riesgo de incidentes.

- Facilitando el cumplimiento cuando la regulación se formalice.

- Construyendo confianza con clientes y stakeholders que cada vez más exigen transparencia sobre cómo operan sistemas de IA.

Los frameworks de gobernanza propuestos por Singh y Harari establecen que la regulación efectiva no es un obstáculo para la innovación, sino una condición necesaria para la adopción sostenible de la IA.

Sin embargo, la regulación es solo una dimensión del paisaje complejo que las empresas deben navegar.

Más allá de los frameworks legales, existen advertencias sobre riesgos técnicos, consideraciones estratégicas sobre capital humano, vulnerabilidades de seguridad y desarrollos competitivos que merecen atención.

Las perspectivas de líderes adicionales en Davos 2026 proporcionan un contexto crucial sobre dimensiones que podrían pasar desapercibidas si solo se enfoca en aspectos técnicos o regulatorios.

Te las compartimos a continuación.

Perspectivas adicionales sobre el futuro de la inteligencia artificial

Más allá de las narrativas dominantes sobre capacidades técnicas, impacto laboral, infraestructura energética y regulación, los líderes en Davos 2026 identificaron dimensiones adicionales críticas que empresas y emprendedores deben considerar al navegar el paisaje de la IA.

Estas perspectivas abordan desde la estrategia organizacional hasta riesgos de seguridad.

Desde la gestión de talento hasta implicaciones geopolíticas, y desde vulnerabilidades técnicas hasta consideraciones éticas sobre transparencia.

Para empresarios y ejecutivos, estas perspectivas adicionales son muy importantes, porque frecuentemente representan riesgos ocultos u oportunidades no obvias.

¿En qué sentido? Una empresa puede tener una tecnología superior, un cumplimiento regulatorio impecable y una infraestructura energética asegurada, y aun así fallar porque:

- Eliminó roles junior destruyendo su pipeline de talento.

- Implementó agentes de IA que crearon vulnerabilidades de seguridad catastróficas.

- No anticipó una consolidación de mercado que favorece a jugadores con ventajas estructurales.

Estas perspectivas ofrecen señales de alerta y consideraciones estratégicas que complementan el análisis principal sobre el futuro de la inteligencia artificial.

-

IA Agéntica, upskilling y cuellos de botella de data centers

Andrew Ng, fundador de DeepLearning.AI y profesor de Stanford, identificó cuatro temas dominantes en Davos 2026:

“IA Agéntica, IA Soberana, upskilling del talento y cuellos de botella de data centers en energía, chips GPU y memoria”.

Ng enfatizó que el impacto transformador requiere “dirección estratégica” y rediseño completo de workflows.

Esta observación de Ng es crítica para las empresas: adoptar IA no es una decisión táctica que puede delegarse completamente a equipos técnicos.

Requiere un liderazgo ejecutivo que comprenda implicaciones estratégicas y esté dispuesto a rediseñar procesos fundamentales.

Las empresas que tratan a la IA como “otro proyecto de IT”, sin involucramiento de su C-suite, típicamente obtienen resultados decepcionantes.

El rediseño de workflows significa repensar desde cero cómo se hace el trabajo, no simplemente automatizar procesos existentes ineficientes.

A su vez, Cathy Li, jefa del Centro para la Excelencia en IA del Foro Económico Mundial, advirtió sobre eliminar trabajos de entrada.

Ese será “el mayor error que cometerás”, dijo, cuando se le consultó sobre si la destrucción de roles junior elimina los pipelines de talento.

Para las empresas que implementan automatización, esta advertencia es crucial: si eliminas posiciones entry-level donde los roles juniors aprenden el negocio, ¿de dónde vendrán tus futuros managers y ejecutivos?

Esta es la trampa estratégica: ahorros de corto plazo en costos laborales generan crisis de talento a mediano plazo.

Una estrategia alternativa: redefinir roles junior como “supervisores de agentes de IA”, donde juniors aprenden el negocio supervisando decisiones de IA en lugar de ejecutar tareas manualmente.

Esto preserva el pipeline de talento mientras captura eficiencias de automatización.

-

Riesgos de seguridad de los agentes de IA

Meredith Whittaker, presidenta de Signal Foundation, advirtió sobre los riesgos de seguridad de los agentes.

“Los agentes de IA son ‘bastante peligrosos’ para servicios encriptados porque requieren acceso a enormes cantidades de datos”, explicó.

Asimismo, dijo: “Si das permisos de root access a un sistema, puede ser hackeado”, describiendo esto como “romper la barrera sangre-cerebro entre la aplicación y el sistema operativo”.

Para empresas implementando agentes autónomos que acceden a sistemas internos, bases de datos de clientes o información financiera, esta advertencia es crítica.

Un agente con permisos amplios puede ser vector de ataque: si el adversario logra manipular el agente (mediante prompt injection o explotación de vulnerabilidades), puede conocer todo a lo que el agente puede acceder.

En consecuencia, la arquitectura de seguridad debe incluir:

- Principio de privilegio mínimo (agentes solo acceden a lo estrictamente necesario).

- Sandboxing (aislar agentes de sistemas críticos).

- Monitoreo continuo de comportamiento anómalo.

-

Transparencia de los modelos de IA

Yoshua Bengio, científico ganador del Premio Turing, alertó que los sistemas actuales de IA se entrenan para imitar tan bien a humanos que los usuarios piensan erróneamente que “son como nosotros”.

Por lo tanto, Bengio pidió más transparencia sobre la naturaleza no humana de los modelos.

Esta observación tiene implicaciones para el diseño de producto. Interfaces que antropomorfizan excesivamente a los sistemas de IA pueden:

- Crear expectativas incorrectas en usuarios, generando sobreconfianza en las capacidades del sistema.

- Atribuirles cualidades humanas como comprensión genuina.

- Atribuirles empatía, algo que los modelos actuales no poseen.

Entonces, para las empresas que están desarrollando productos de IA, el diseño de interfaz debe balancear usabilidad con transparencia sobre las limitaciones del sistema.

-

La “erosión epistémica” causada por los deepfakes

Rachel Botsman, experta en confianza digital, advirtió sobre la “erosión epistémica” causada por los deepfakes, citando estudios que muestran que medios sintéticos manipulan la percepción con más de un 85 % de eficacia.

Esta “erosión epistémica” se refiere al deterioro de la capacidad colectiva para discernir qué es real versus sintético, afectando la confianza en medios, instituciones y comunicación en general.

Para las empresas, esto crea desafíos en verificación de identidad, autenticación de comunicaciones y protección de marca.

Si los adversarios pueden crear deepfakes convincentes de CEO o voceros corporativos, las empresas necesitan estrategias para verificar la autenticidad de sus comunicaciones oficiales.

En tal sentido, es viable que ciertas tecnologías emergentes como firmas criptográficas en contenido auténtico y sistemas de verificación de identidad biométrica multifactor puedan mitigar estos riesgos.

-

“Human in the loop” vs. “Human in the lead”

Paralelamente, Julie Sweet, CEO de Accenture, articuló en Davos la filosofía que define la implementación de Agentic AI en el futuro de la inteligencia artificial: “Human in the lead, not human in the loop”.

Esta distinción es fundamental para el futuro de la inteligencia artificial en las organizaciones.

“Human in the loop” significa que la IA hace recomendaciones y el humano aprueba cada decisión.

Mientras que “Human in the lead” significa que el humano establece estrategia mientras la IA ejecuta tácticamente y toma decisiones operacionales sin aprobación constante, interviniendo el humano solo en excepciones o decisiones estratégicas.

Conclusiones sobre el futuro de la inteligencia artificial según el FEM

Las declaraciones presentadas en Davos 2026 establecen un rango de proyecciones sobre el futuro de la inteligencia artificial que varía desde su transformación acelerada en 1 o 2 años hasta su evolución gradual en 5 o 10 años.

Los principales líderes de IA del mundo, que se dieron cita en Davos, coinciden en que el impacto será sustancial, aunque difieren significativamente en timelines, magnitud y áreas específicas de transformación.

El desarrollo de Physical AI más rápido de lo anticipado, las proyecciones del FMI sobre el 40-60 % de empleos afectados y las restricciones de energía emergen como factores determinantes para el futuro de la inteligencia artificial en los próximos años.

El consenso sobre la necesidad de gobernanza contrasta con la fragmentación regulatoria global.

La propuesta de políticas conscientes del contexto que balancean principios horizontales con requisitos verticales por sector representa el enfoque emergente, mientras que el “Runtime Governance” se establece como una nueva necesidad para los sistemas adaptativos.

Asimismo, las advertencias sobre sostenibilidad del sector —propuestas por Jassy y Nadella— y el cambio de narrativa hacia un ROI mensurable indican una fuerte maduración del ecosistema.

Por otro lado, la dependencia energética y el concepto de “permiso social” introducido por Nadella sugieren que las limitaciones no técnicas de la IA podrían determinar el ritmo de desarrollo tanto como los próximos avances algorítmicos.

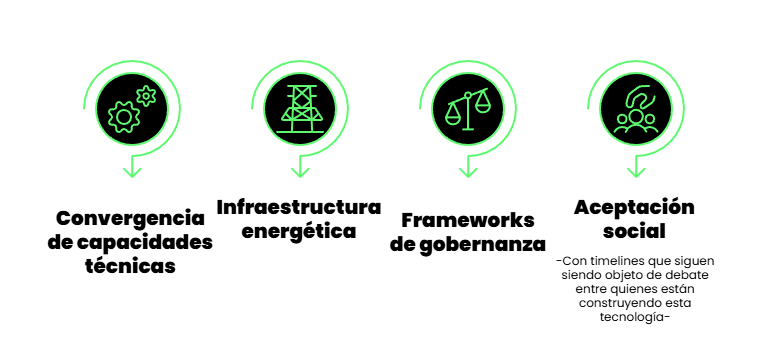

El futuro de la inteligencia artificial, según más de 150 fuentes verificadas y la información compartida por 47 líderes presentes en Davos 2026, será definido por:

Para cerrar, acá compartimos una declaración que invita a la reflexión, compartida por Bret Taylor, desde su posición como CEO de Sierra y Chairman del Board de OpenAI:

“La IA es probablemente una burbuja. Cuando todos saben que la IA tendrá un gran impacto, el dinero es abundante. Dinero inteligente y dinero tonto están financiando competidores”, y ante semejante escenario, predijo “corrección y consolidación” en el sector en los próximos años.

Continuar leyendo: Tendencias de inteligencia artificial 2026: Guía completa

Suscríbete y recibe en tu mail:

500 ideas para crear posts que llevarán tu blog a otro nivel. Suscríbete y recíbela en tu correo.

500 ideas para crear posts que llevarán tu blog a otro nivel. Suscríbete y recíbela en tu correo.

Compartir en: